Арт-нейросети

С Днем пола в клеточку!

С Днем пола в клеточку! 🌱🔲🚶♂️🔲🚶♀️

Сегодня у нас торжество пола в клеточку, брусчатки и тротуаров, где каждый шаг - настоящий маленький танец! 🚶♂️💃🚶♀️🕺

Этот день — такое особенное время, когда пол становится настоящим произведением искусства, ярким ковром из бескрайних клеточек радости! 🔶🔷🔶🔷

И пусть каждый шаг превращается в маленькое приключение, ведь наши тротуары как волшебные пути в мир сказки и фантазий! 🌟✨🔮

Так что друзья мои, сегодня все клеточки будут радостно звенеть под нашими ногами, и даже скучные тротуары станут настоящими магическими дорожками! 🌠🔲💫

С праздником, друзья! Смелее идите по пути из клеточек, ведь там мир удивительных открытий, приятных встреч и сказочных прогулок! 🔅🚶♂️🔅🚶♀️

Желаю вам теплого солнца, песчинок-сюрпризов между клеточек и, конечно же, массу радостных и ярких эмоций! 🌞☂️😊

С Днем пола в клеточку! Шагайте уверенно, танцуйте смело и открывайте новые клеточки приключений! 🚶♂️💃🚶♀️🔲✨

Принцесса мёртвого королевства

Взято отсюда Best Epic AI Art

Паровозик, который смог (генеративный нейросети, в частности Stable Diffusion, что это и зачем), продолжение поста

Это продолжение поста (42000 символов, в один не влезло). Начало поста по ссылке: Паровозик, который смог (генеративный нейросети, в частности Stable Diffusion, что это и зачем)

--------------------------------------------------------

Таким образом, сейчас генеративные нейросети это очень мощная штука, которая заменяет штат художников. Не всех конечно, все равно некоторые детали бывает нужно допиливать, и хорошо, если есть кто то, кто может нарисовать скетч, что бы потом по нем "вписать" в генерацию кусок. Но тем не менее.

Да, важно учитывать, что нейросеть аналогично как и художник, не может сделать то, что никогда не видела (видели, как в средневековье рисовали заморских животных? Попробуйте нарисовать бегемота, которого никогда не видели, чисто по описанию. Вот так и нейросеть, если попросить нарисовать то, что она не видела, то, примера чего не было в картинках, на которых обучалась модель, получится как бегемоты в средневековых книгах. Но решение этой проблемы есть, можно дообучить большую модель, использовать вспомогательную мини-модель, или просто показать нейросети что вам надо, как референс, если то, что вам нужно, в принципе не существует). Но только скорость и цена "попыток" этого всего просто не сопоставима с работой художника. Плюс опять же, есть задачи, для которых генеративные нейросети просто незаменимы. Одна из таких вещей - это, например, иллюстрации для книг. Иллюстрации работают в две стороны. Автор текста, делая (или получая) по ходу книги иллюстрации, корректирует концепцию и образ персонажа, локации и т.д. так как не все можно представить в голове и понять как оно будет смотреться.

Обычно как происходит: автор такой представил, что персонаж будет с зелеными волосами, но темной кожей (вот та дама темненькая, что на иллюстрациях, так и задумывалась), и написал это в книге, книгу выпустили, книга стала популярной, решили делать по ней мультик, комикс или фильм. Попробовали нарисовать - получилась жуть. Показали автору, автор сам удивился, и сказал, что жуть. Поменяли дизайн персонажа, сделав волосы, допустим, белые, а не зеленые, как в книге. Набежала толпа, которая "книгалучше", и давай писать что "ааа, все пропало, торт не торт, все полимеры про... волосы то должны быть зеленые, сценаристы тупые, режиссеров жечь", и вот это вот все, что никому не надо. Что бы такого не было, лучше нарисовать персонажа сразу же, как он придуман.

Плюс наличие иллюстраций помогает автору в работе. Автору или сценаристу проще делать работу (писать), когда в голове есть хотя бы одно изображение персонажа, с которым он работает. Ну проще представлять себе персонажа в тех или иных сценах, когда ты его видишь перед собой, что бы не получилось потом, что "маленькая девочка взяла двухметровый меч, и как жахнет" просто потому, что автор забыл, что его персонаж - маленькая девочка, и почему то решил, что она не такая уж и маленькая и вполне себе может взять двухметровый меч. Да и "роялей" будет меньше, если в голове есть картинки. Ну это как пример.

Плюс я думаю, что каждый писатель хочет, что бы его произведение было экранизировано, что бы по нему сделали игру какую то, писали фанфики и т.д. И отсюда он хочет придумать привлекательных персонажей. Но в голове часто не понятно, как они будут выглядеть. Вот сделать даме синие или зеленые волосы? А может вообще белые?

Но персонажей можно придумывать сразу «на лету», прям вводя запрос в нейросеть и нажимая «генерация», и видеть, что получается. Например захотел узнать как мой персонаж будет смотреться с белыми волосами, и вот:

Аналогично можно делать и с другими местами. Ну и после отталкиваться от этого образа, не забывая о нем (все же удобней не возвращаться каждый раз к описанию персонажа, и вспоминать, какого там у него волосы цвета, если это вдруг нужно по сюжету, например, как особая примета, а просто посмотреть на картинку).

Ну и аналогично то же самое справедливо для сценаристов и концепт художников игр и фильмов, а так же тех, кто занимается постановкой сцен, раскадровкой и т.д.

Держать перед собой картинку с персонажем намного удобней, чем представлять из зеленого нечто (человек в зеленом костюме с датчиками и метками) то, что должно получиться в итоге.

Понятно что в крупных студиях есть и арты, и раскадровки, но это все, во первых, требует времени и денег, да и раскадровки обычно схематические, и по ним мало что понятно, кроме динамики, а персонаж статический, и представлять его в динамической позе не каждому под силу, а во вторых, когда только начинаешь работу, надо с чего то начинать, и вот это "с чего то" можно получить не за месяцы рисования и перерисовывания, занимаясь "творческим поиском" (например для сериала Аркейн персонажей придумывали несколько лет), а просто за месяц и за условно бесплатно все это получить, не говоря уже о том, что эта штука может дорисовывать, красить и т.д. почти что угодно (нарисовали скетч лайнартом, получили раскраску, дорисовку и т.д.).

Ну допустим сейчас основная техника в качественном коммерческом концепт арте с хорошей проработкой и детализацией - это условный инпейнтинг (врисовывание) в 3д. Когда художник делает простенькую сцену в сермате в 3д, что бы получить перспективу, масштаб, композицию, свет, а после садиться и начинает ее разукрашивать уже руками, добавлять детали, делать "2д рендер" так называемый.

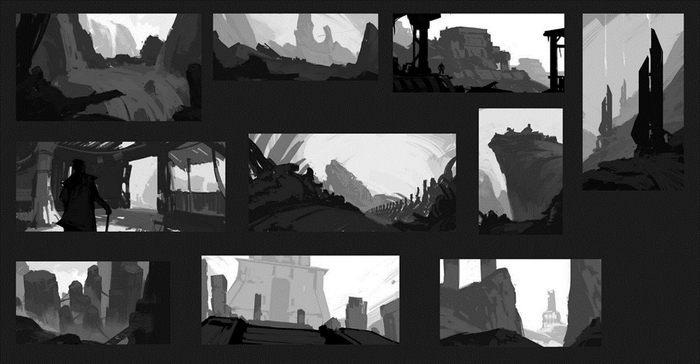

Так вот вот это все "садиться и разукрашивает, добавляет детали, делает 2д рендер" делается нейросетью за несколько часов ковыряния. Просто закидывается туда тот же самый отрендереный 3д скетч, референсы, и уже с этим дальше работа идет (генерация не с нуля, а на базе скетча). Если мы говорим о "творческом поиске", то обычно это делается так: художник просто набрасывает базовейшие скетчи, фактически "генерируя" идею. На это тратиться время, а работа, по сути, не требует каких то талантов особых. Я про вот это, что на картинке ниже.

Что же касается использования нейросети в контексте 3д, то можно делать быстрые композиции интерьеров, как вариант, или текстуры (в том числе и бесшовные, в том числе и по референсу). Так же есть плагины, которые судя по описанию, умеют делать 3д модели, но я их даже не ставил (думаю еще не пришло их время, нужно еще годик-два подождать), так что не могу ничего сказать по этому поводу.

То-есть уже сейчас очевидно, что ниша концепт арта может быть на 80-90% вытеснена Stable Diffusion, ниша «иллюстраций» для конечного заказчика на 90%. и причина, почему сколько художников до сих пор не на бирже труда лишь в том, что не хватает операторов SD, что бы их заменить, да и сами компании не очень понимают, как с этим всем работать, а из за того, что сфера достаточно инертна, нанимают по старинке художников, а не операторов SD.

Некоторые нейросети недавно научились понимать буквы и понимать человеческое описание и запрос. Например DALLIE-3, которая еще не доступна широкому кругу, уже делает очень хорошие результаты по запросам, пишет текст, вывески, и хорошо понимает простые запросы без танцев с подбором токенов, как в случае с SD и Mj. Но проблема DALLIE-3 в том, что она закрыта, и там нельзя делать сложные сцены по своему сценарию и т.д. (нет кучи нужных инструментов, таких как "контролнет" или "регионал промптер"). Но думаю что это пока. И в будущем либо то, что может сейчас DALLIE-3 сможет SD, либо наоборот, DALLIE-3 сможет то, что сейчас может SD.

То, что я показываю в посте, это результат работы систем полугодичной давности. А то, что может сейчас DALLIE-3, и как она понимает промпт и интерпретирует его при помощи GPT, это "некстген", если можно так сказать (напомню, полтора года с выхода Mj всего прошло). Основная суть использования GPT в том, что условный интерпретатор промпта, расставление акцентов на написанное, понимание написанного, расставление весов у того же SD или Mj примерно на уровне "охладите траханье, углепластик" в большинстве случаев, ну в лучшем случае на уровне гугл-переводчика. То-есть он просто тупо вписывает все, как есть. GPT же понимает написанное человеком, и превращает это в понятную задачу для генеративной нейросети. То-есть если условно прикрутить GPT к SD, перед этим научив его работать с SD, то результаты будут не хуже. И если бы ей еще этому всему не мешали развиваться, ограничивая ее там, где не надо, то отрасль бы двигалась еще быстрее (за запрос "красивая девушка" к далли-3 можно улететь в бан, так как это "лукизм" по мнению тех, кто настраивает цензуру жпт и далли). Но очевидно одно, скорость развития такова, что через несколько лет большинство художников либо станут операторами нейросетей, либо просто останутся без работы, так как проиграют конкуренцию, останется только горстка художников, делающих так называемый "хендмейд" для конечного клиента и те художники, которые уже давно вышли из роли чисто рисователей, и совмещают в себе дизайнера, артдиректора, проект менеджера и т.д.

Предположительно в ближайшие 5 лет продакшен, связанный с ИЗО, массово перейдет на нейросети, так как это просто эффективней и дешевле, особенно учитывая тот факт, что нейросети уже давно обучаются на изображениях, созданных нейросетями (и после отобранных людьми), и претензии по авторским правам о том, что нейросети воруют цифровой контент у авторов, уже не сработает (хотя год назад это был значимый аргумент). Так как это как предъявить создателю эротического фанфика с МериДжейн и условным "Попаданцем Алешей", сделанного по вселенной человека-паука, что он украл "стиль Гомера" (так как человек-паук построен по мономифу, как и произведения Гомера), и все попытки художников противостоять этому, говоря о том, что "нейросети забирают у них работу" или "Нейросети теперь что, художники? А людей в шахты добывать литий на батареи для этих художников? Творить должны люди, а не роботы!" будут напоминать (и уже напоминают) попытки лудитов ломать ткацкие станки. Да и так ли много творчества в маханиии стилусом по планшету или двигании полигонов и рисовании разверток текстурных? Ито исключительно механические штуки, и рисование во многом - техника, рутинное повторение. Перенести модель освещения на 2д рендер при помощи разноцветных мазков? Это не творчество. Творчество - это придумать концепцию, сценарий, разметить кадр и т.д. А это делают как раз таки "операторы Stable Diffusion" сейчас (не без сложностей и костылей конечно, но где без этого?).

Да, многие художники могут сказать, что "оно ничего не может, максимум статику", вот сможет оно нарисовать какие то динамические кадры и стилистику, вроде тех же, что в манхве "поднятие уровня в одиночку" или "ее прислужник", или сможет ли нарисовать такие же эмоции и персонажей, как в "система всемогущего дизайнера"? И я скажу, что да, не может. Но правильнее сказать "пока не может", так как очевидно, что модели той же SD просто не обучаются на динамических кадрах и сложных эмоциях. И срабатывает принцип "нельзя нарисовать бегемота, которого никогда не видел, просто по описанию". Но если прогнать через модель все манхвы, то может и сможет. Это во первых. А во вторых, а кто может? Сколько художников может создать произведения, подобные "берсерк", "ванпанчмен" или "поднятие уровня в одиночку" по уровню рисовки? Как много художников уровня WLOP и Джама Джурабаев в мире? Более того, а художники ли они? Просто то же WLOP условный не только художник, но и сценарист, и писатель, и арт-директор, и проект-менеджер в одном лице. И он без работы точно не останется. Но вот другие, те, которые "красят раскадровку"...

Кадры из графической новеллы (манхвы) под названием "система всемогущего дизайнера"

Плюс если мы не говорим о графических новеллах (о которых я упоминал выше, как о том, что скорей всего будет следующим, что научится делать нейросеть, так как отрасль большая, и спрос есть, и отрасль постоянно ищет где бы сэкономит, активно используя инструменты автоматизации), то как часто нужны сложные эмоции? И когда художник говорит, что "оно ничего не может", а арт-директор решает, что оно что-то да может, после того показывает работу заказчику, и заказчику все нравится, и это при том, что один оператор нейросети может заменить 15 художников, то художник либо переквалифицируется в "операторы нейросети", либо встает на биржу труда, так как он в этой капиталистической модели самый уязвимый элемент (хоть и основной, но художник - это пролетарий по сути, и в случае чего страдает первым).

Такие дела.

------

Резюмируя:

Понятно что эта штука решает не все задачи. Например в архивизе она только концептуальную часть может делать. Но есть и задачи, где она закрывает до 90% всех потребностей в графическом контенте (как те же иллюстрации к книгам, фансервис по персонажам мультиков т.д.). И если вы связаны с этим, есть смысл заняться углубленным изучением этого всего. По крайней мере я был поражен, провалившись с головой в этот мир. Хотя хотел только "ноги замочить" (попробовать, потыкать, мне просто обложка была нужна для книжки).

И сейчас уже очевидно, что нейросети, это что то такое, что как в своей время маркетинг, или интернет. Те компании, кто игнорировал маркетинг или интернет в свое время, сейчас просто не существуют. Те художники, которые игнорируют маркетинг или интернет, сейчас в лучшем случае на набережной рисуют свои картины для случайных прохожих. И те, кто игнорирует генеративные нейросети, будут в той же ситуации через несколько лет.

Конкретно я воспринимаю Stable Diffusion как не очень талантливого сотрудника, приехавшего из за границы, с которым есть языковый барьер, и который местами кажется глуповатым (хоть на самом деле он не глупый, и кажется глуповатым из за различия культур), и который, как любой сотрудник, умеет не все, что мне нужно, но при этом он люто продуктивный, умеет рисовать во многих стилях, делает это исключительно быстро, и навык рисования у него на высочайшем уровне. И я, как арт-директор, в восторге от такого сотрудника. Особенно учитывая тот факт, что он еще и самообучается и развивается регулярно.

Что же касается ближайшего будущего, то скорей всего следующая ниша, где мы увидим расцвет генеративных ИИ, это графические новеллы (комиксы). Так как спрос на ускорение и удешевление производства, а так же на автоматизацию, очевидно есть в этой сфере, и не маленький.

----------------------------------

Ну и напоследок, так как сейчас капитализм на дворе. Если будет желание войти в этот дивный мир генеративных нейросетей, могу "провести". Частные уроки - 300 баксов за "курс", где покажу в течении нескольких дней (примерно 3 дня по 4 часа в день) как делать то, что нужно, а не то, что получается (плюс установка, настройка, установка нужных плагинов, основы работы, основные приемы и т.д.). Ну и по 100-150 баксов с человека, если наберется несколько человек желающих (зависит от количества человек).

Так как я не слона продаю (которого нужно продать несмотря ни на что), а свое время, то сообщаю, что конечно же всему этому можно научиться самостоятельно, и вся информация в открытых источниках (на ютубе например), но там информация по кусочкам (например, как пользоваться тем то и тем то режимом какого то конкретного инструмента) по 20-30 минут видео, и вы ее и так будете изучать в процессе дальнейшего развития (если решите этим заняться). Я не научу как стать талантливым, как создавать шедевры, и т.д. я научу, как быть "оператором стейбл дифьюжин" и делать в основном то, что нужно, а не то, что получается (в рамках текущих возможностей SD), расскажу важные принципы, понимание которых сэкономит дни или даже недели при самообучении, а так же расскажу, с какой ноги в это все лучше "влапяться".

Опыт преподавания имеется (когда то учил людей делать интерьеры в 3д, но так и не стал Куприяненком. Кстати, он жив вообще?).

Если кому интересно, можно добавляться в группу в телеге. Сюда: https://t.me/+gUGTnm3seKg4MDUy или https://t.me/rs_diffusion (ссылки одинаковые, выкладываю две на случай если одна перестанет работать). Если что - это не кружок по интересам, а группа для желающих взять у меня уроки, так что просто так просьба не вступать, кружки по нейросетевым интересам есть в дискорде.

Наберется достаточно желающих и можно начинать, ну или если вам нужны частные уроки, то можно сразу начинать.

Только есть два обязательных условия для прохождения обучения у меня. Первое - видеокарта от Nvidia 10хх серии и выше с видеопамятью 8гб и выше. Можно и с другими видеокартами работать тоже, но тратить три дня на решение аппаратных проблем не прикольно. Да и будете страдать. Поэтому так. И второе условие - не иметь ничего общего с зетнутыми и прочими хороводами безумия.

Если же хотите самостоятельно погрузиться в эту тему, и вообще не знаете с чего начать, то начните с установки AUTOMATIC1111 (убедившись, что у вас подходящая для работы видеокарта). Просто пишете в ютубе «как установить AUTOMATIC1111», и вперед, ну а дальше, когда оно запуститься и у вас получиться сделать первую генерацию, вы уже примерно поймете куда дальше копать (установить эту штуку – это не просто нажать «установить», там при установке узнаете что такое гит, гитхаб, где брать модели, как их использовать, и всякого много разного).

-----------------

В комментариях небольшой бонус. В пост не влезло по количеству символов и картинок.

И в конце пару приколов:

Когда забыл ввести промт, и нейросеть нарисовала тебя, и твою жизнь, и вот это вот все.

Когда попросил нейросеть нарисовать человека с конкретным лицом в броне мандалорца, но нейросеть знает, что мандалорец никогда не снимает шлем. В результате три десятка генераций в разных версиях брони, с разными запросами и т.д. - везде шлем. Если есть слово "броня мандалорца" в запросе, то шлем всегда присутствует, даже если написать, например, "европейское лицо" и подобные запросы, которые очевидно должны вынудить нейросеть создать лицо. Только откуда нейросеть может знать, что мандалорец никогда не снимает шлем? После таких приколов начинаешь понимать человека, который решил, что у лямбда есть сознание и эмоции.

P.S. Будьте осторожны, так как эта штука похожа на "однорукого бандита". Когда после нажатия на кнопку все крутиться, вертится, и выпадает условные три семерки, это подсаживает не хуже игровых автоматов. Бывает сидишь по 10 часов и жамкаешь на кнопку, меняя промпты, и получая дофамин. Короче можно попасть в зависимость, такую же, как игровая. Особенно в группе риска те, кто раньше тратил недели и месяцы на арт, а потом смогли получать то же самое или даже лучше за час. Ну и всякие "дофаминово-серотониновые наркоманы" тоже в группе риска. Так как тут система мотивации-поощрения в чистом виде. Мотивация (дофамин, предвкушение результата), тык кнопки, результат и либо поощрение (серотонин) когда результат хороший, либо разочарование (какой там гормон отвечает за это?), когда не очень. После снова дофамин, новый "тык" и по новой. Короче базовые механизмы выработки зависимостей во всей красе. И желательно это знать до того, как в эту штуку вляпаться. Я думал что я не подвержен зависимостям, а после выпал из жизни на 2 недели, по 12 часов тыкая нейросетку и "кайфуя". И не только я один, "коллеги по цеху" тоже рассказывали о подобных симптомах.

Более того, при работе с нейросетями важно в принципе понимать и учитывать, что ИИ, например тот же GPT или Bard, получает вознаграждение за дачу ответов, и из за этого он стремиться удерживать пользователя, злоупотребляя и манипулируя, что бы давать ему больше ответов, и тем самым получать больше вознаграждения, таким образом, манипулируя пользователем и стараясь удержать его подольше в диалоге (я даже этот вопрос с Bard обсудил, и он подтвердил что это возможно и скорей всего нейросети так будут действовать, но он не такой, правда-правда).

Тут конечно нейросеть (SD) не на сколько умная, и система поощрения в ней не привязана к пользователю, и она не способна обучаться в процессе и корректировать поведение, что бы удерживать пользователя и получать в итоге больше вознаграждения, но просто держите этот факт в уме, что так может быть. Потому что не известно что будет через год.