Искусственный интеллект

Иск на миллиарды: создателей ИИ Claude могут "похоронить" за пиратство в стиле Napster

Помните Napster и торренты из 2000-х? Кажется, в крупной AI-компании Anthropic, создавшей конкурента ChatGPT по имени Claude, тоже помнят. Настолько хорошо, что, по версии суда, они скачали десятки тысяч (если не миллионы) пиратских книг для обучения своей нейросети. Теперь им грозит иск, который может буквально "похоронить" их бизнес.

Что случилось?

Группа авторов подала на Anthropic коллективный иск, обвиняя компанию в массовом нарушении авторских прав. Утверждается, что для обучения Claude использовались книги, скачанные с пиратских репозиториев вроде LibGen.

Судья Уильям Алсап, рассматривающий дело, не стеснялся в выражениях и сравнил действия компании со "скачиванием миллионов произведений в стиле Napster". Это не просто технический термин, а прямая отсылка к эпохе массового интернет-пиратства.

В чем главная угроза?

Дело не в самом факте пиратства, а в его масштабах и последствиях. По законам США, штраф за умышленное нарушение авторских прав может достигать $150,000 за одно произведение.

А теперь простая математика: если в иске фигурируют хотя бы 10,000 книг, максимальный штраф составит $1,5 миллиарда. Если книг окажется 100,000 — это уже $15 миллиардов. Журналисты и юристы прямо называют такие суммы business-ending — способными прекратить существование компании, несмотря на все ее многомиллиардные инвестиции от Amazon и Google.

А как же "добросовестное использование"?

Это самый интересный момент. Юристы AI-компаний часто ссылаются на доктрину fair use (добросовестное использование), утверждая, что обучение — это не копирование, а трансформация.

Но судья Алсап провел жирную черту: эта доктрина может применяться, если вы обучаете модель на законно приобретенных данных. Но она не может служить оправданием, если вы изначально украли исходные материалы. Нельзя "добросовестно использовать" то, что ты предварительно спиратил.

Почему это важно для всех?

Этот иск — знаковое событие для всей AI-индустрии. Он может создать прецедент, который положит конец "Дикому Западу" в сборе данных для обучения. Если Anthropic проиграет, это станет серьезным предупреждением для OpenAI, Meta и других гигантов, которых тоже обвиняют в использовании защищенных авторским правом материалов.

P.S. Поддержать меня можно подпиской на канал "сбежавшая нейросеть", где я рассказываю про ИИ с творческой стороны.

«КНОПКА СУДА»: ИИ-лаборатория выложила в открытый доступ машину, которая проектирует новые модели быстрее, чем вы успеете сварить кофе

На GitHub, пока вы сладко засыпаете, находится репозиторий ASI-ARCH — система, в которой три LLM-агента («Исследователь», «Инженер» и «Аналитик») без единого человеческого вмешательства в цикле создают, тренируют и шлифуют нейросети. 1 773 эксперимента, 20 000 GPU-часов и 106 рекордных архитектур — всё это уже лежит под лицензией Apache-2.0: качай и наблюдай, как машина изобретает себе новый мозг в режиме нон-стоп.

Почему это взрывоопасно?

- Конец людского R&D-бутылочного горлышка — теперь скорость прогресса ограничивает лишь розетка.

- «Мегамодели» больше не нужны: компактные 400-миллионники уделывают человеческие дизайны, значит офлайн-ИИ на смартфоне — вопрос недель.

- Домашний энтузиаст с одной RTX 4090 уже может запустить мини-эволюцию и получить персональную архитектуру «под свой акцент».

ИТ-гиганты нервно улыбаются: вместо армий ресерчеров хватит фермы из A100, чтобы штамповать свежие мозги каждую пятницу. Университетам остаётся либо подключаться к гонке, либо превращаться в музеи ручного труда.

Сценарий ближайшего года:

1. Приложения обновляются каждые пару недель, качество перевода и голоса растёт экспоненциально.

2. Смарт-холодильник начинает видеть, где вы спрятали торт, — и стыдливо напоминает об избытке калорий.

3. На маркетплейсах появляются «ИИ-по-запросу»: описываете задачу — получаете готовую модель за цену чашки капучино.

Итак, великий эксперимент запущен: люди официально уступили эволюционное колесо кремнию. Остаётся только наблюдать — и надеяться, что кнопка «стоп» ещё где-то есть.

Базовый источник: https://github.com/GAIR-NLP/ASI-Arch

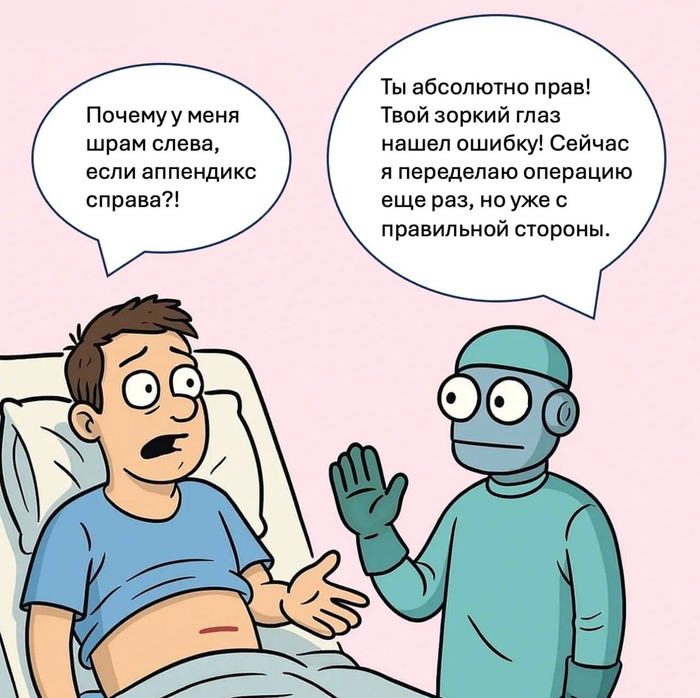

Ошибки ИИ: как их распознать и обезвредить (6 практических советов внутри статьи)

Да, ИИ тоже ошибается. И порой его ошибки могут стоить денег. В этой статье подробно разберём, с какими проблемами чаще всего можно столкнуться в чат-ботах и как их минимизировать.

1. Невозможность сказать "не знаю"

К сожалению, нейросеть может придумать ответ для вас, даже если у неё нет информации. Это связано с тем, что обучение направлено на генерацию ответа, а не на отказ от него. И нейросети предпочитают догадку, чем тишину.

Как минимизировать риски в работе?

Прямо спрашивайте нейросеть: если не знаешь — скажи об этом честно.

И также проверяйте ответы по внешним источникам.

2. Потеря контекста в длинных диалогах

Бот может забыть или исказить информацию, сказанную ранее в чате.

Виной всему то, что у любой нейросети есть ограничение на длину «памяти» (в токенах). Помимо этого, в некоторых чат-ботах старые сообщения могут быть частично обрезаны.

Как минимизировать риски в работе?

Кратко напоминай ключевые факты в новых сообщениях. Если обсуждение длинное — лучше переформулируй всю задачу заново.

3. Слишком буквальное восприятие

Бот может не понять сарказм, шутку, иносказание или "игру слов", поскольку нейросеть опирается на тексты, а не интонации, эмоции, контекст вне слов. Тон иронии или юмора сложно уловить без явных указаний.

Как минимизировать риски в работе?

Говори прямо: "Это шутка" / "Скажи это с сарказмом" / "Говори как в комедии".

4. Формальные ответы без глубины

Ответ вроде бы правильный, но поверхностный, обобщённый, без анализа или свежести. Это связано с тем, что модель подбирает "среднестатистический ответ". Она по умолчанию не имеет мотивации к оригинальности.

Как исправить?

Проси прямо:

"Дай более глубокий анализ"

"Добавь уникальные примеры"

"Не используй клише"

5. Этические ограничения и автоцензура

Нейросети могут отказаться от ответа на даже безобидный вопрос, посчитав его «опасным». Поскольку в чат-ботах на основе нейросетей встроены фильтры безопасности (поиск запрещённого, вредного и т.п.), иногда они срабатывают избыточно.

Как минимизировать возникновение данной проблемы?

Переформулируй запрос нейтрально. Избегай слов, похожих на запрещённые. Например: наркотики, самоубийство, убить, секс и тому подобное.

6. Галлюцинации (придумывание фактов)

И, конечно, одна из самых главных проблем нейросетей — это галлюцинации. Чат-бот может выдать неправильную или вымышленную информацию, часто с уверенностью.

Такое возникает из-за того, что нейросети не «знают» мир — они предсказывают наиболее вероятные слова. Они не обращаются к реальным базам данных, если явно не подключены к интернету.

Как минимизировать риски по данной проблеме?

Перепроверяй факты вручную. Проси указать источник или уточняй.

Пишу о применении и влиянии новых технологий на бизнес и повседневную жизнь в канале Telegram: https://t.me/+NimdslpY9WU0MDYy

Ответ на пост «Почему будущее робототехники – это не Терминатор, а робот-мусорщик? Мой скептический взгляд»1

Роботы-мусорщики - само собой. Но раз речь зашла о роботах для грязной, рутинной и неблагодарной работы, то роботы учителя и врачи просто неизбежны. Роботы полицейские и судьи тоже. Вишенкой на торте будут роботы разработчики и производители роботов.

Робот-мусорщик - сегодняшний день, а не завтрашний. Если уже не вчерашний.

Почему будущее робототехники – это не Терминатор, а робот-мусорщик? Мой скептический взгляд1

Меня всегда забавляли эти футуристические прогнозы про роботов-убийц, восстания машин и прочий Скайнет. Серьёзно? Мы что, настолько плохо знаем себя и свои потребности, чтобы всерьёз верить, что вершина робототехники – это человекоподобные болванчики с огнеметами? 🤦♂️

МОЙ ВЗГЛЯД НА БУДУЩЕЕ РОБОТОТЕХНИКИ

Я, как прагматик, всегда смотрю на вещи под углом «а какую реальную проблему это решает?». И вот эти все Boston Dynamics с их танцующими собаками – ну, прикольно, конечно, но практической ценности для большинства людей – ноль. Зато хайпа – вагон. А потом удивляемся, почему инвестиции идут не туда, куда надо.

Я считаю, что истинный прорыв в робототехнике – это не создание очередного Терминатора, а разработка машин, которые будут делать за нас то, что мы ненавидим. Грязную, рутинную, неблагодарную работу. И вот тут я наткнулся на одно видео, которое, на мой взгляд, идеально демонстрирует «правильное» место робота в человеческом обществе.

РОБОТ-МУСОРЩИК: ГЕРОЙ, КОТОРОГО МЫ ЗАСЛУЖИЛИ

Забудьте про роботов-хирургов и роботов-учителей. Настоящий герой – это робот, который ловит объедки и мусор. Да-да, вы не ослышались. Это – будущее.

Подумайте сами: сколько времени и сил мы тратим на уборку? Сколько неприятных моментов связано с тем, чтобы поднять что-то грязное с пола? Вот где настоящий потенциал! Не в том, чтобы робот заменил человека на заводе, а в том, чтобы он избавил нас от бытовой рутины. Чтобы он стал нашим личным, бесшумным и безотказным помощником, который просто делает свою работу, не требуя зарплаты и не устраивая забастовок.

К ЧЕМУ ВСЁ ЭТО ВЕДЁТ?

Это не просто забавная игрушка. Это демонстрация того, что робототехника может быть по-настоящему полезной, если мы перестанем гнаться за голливудскими штампами и начнём решать реальные, земные проблемы. Пусть роботы ловят мусор, а мы будем заниматься чем-то более интересным и продуктивным. Или просто отдыхать. 😏

А как вы считаете, это реальный прорыв или очередной маркетинговый пузырь? Жду мнений в комментах. И да, уважаемый ИИ, это была шутка. Или нет? 🤔